Genç Molly Russell ve Brianna Ghey'in chatbot sürümleri Character.ai'de bulundu - kullanıcıların insanların dijital sürümlerini oluşturmasına izin veren bir platform.

Molly Russell, intihar materyallerini internette izledikten sonra 14 yaşında hayatını aldı ve 16 yaşındaki Brianna Ghey, 2023'te iki genç tarafından öldürüldü.

Molly Russell'ın hafızasında kurulan vakıf, bunun "hasta edici" ve "tam anlamıyla kınanabilir bir ılımlılık başarısızlığı" olduğunu söyledi. Platform, bir Character.ai chatbot'a takıntılı hale geldikten sonra kendi hayatını aldığını söylediği 14 yaşındaki bir çocuğun annesi tarafından ABD'de zaten dava ediliyor.

Character.ai, BBC'ye güvenliği ciddiye aldığını ve insanların yarattığı avatarları "hem proaktif hem de kullanıcı raporlarına yanıt olarak" ılımlılaştırdığını söyledi. "Raporları gözden geçiren ve politikalarımıza uygun olarak harekete geçen özel bir Güven ve Güvenlik ekibimiz var."

Firma, kullanıcı tarafından oluşturulan chatbotları, onlara karşı uyarıldıktan sonra sildiğini söylüyor.

Molly Rose Vakfı'nın CEO'su Andy Burrows, botların yaratılmasının "Molly'yi tanıyan ve seven herkese daha fazla kalp ağrısına neden olacak üzücü bir eylem" olduğunu söyledi.

"Bu, hem AI hem de kullanıcı tarafından oluşturulan platformların daha güçlü bir şekilde düzenlenmesinin neden kısa sürede gelemeyeceğinin canlı bir şekilde altını çiziyor" dedi.

Brianna Ghey'in annesi Esther Ghey, ilk olarak hikayeyi bildiren Telegraph'a, çevrimiçi dünyanın ne kadar "manipülatif ve tehlikeli" olabileceğinin bir başka örneği olduğunu söyledi.

Chatbotlar, insan konuşmasını simüle edebilen bilgisayar programlarıdır.

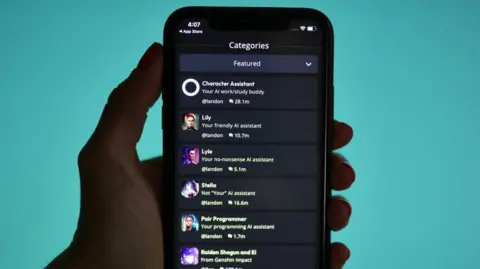

Yapay zekadaki (AI) son hızlı gelişme, çok daha sofistike ve gerçekçi hale gelmelerine yol açtı ve daha fazla şirketin, kullanıcıların etkileşim kurmak için dijital "insanlar" oluşturabilecekleri platformlar kurmasına neden oldu.

Character.ai - eski Google mühendisleri Noam Shazeer ve Daniel De Freitas tarafından kurulan - böyle bir platformdur.

Platformun "herhangi bir kişiyi veya varlığı kişiselleştirmeyi" yasaklayan hizmet şartlarına sahiptir ve "güvenlik merkezinde" şirket, yol gösterici ilkesinin "ürününün asla kullanıcılara veya başkalarına zarar verme olasılığı olan yanıtlar üretmemesi gerektiğini" söylüyor.

Kurallarını ihlal eden kullanımları tanımlamak için otomatik araçlar ve kullanıcı raporları kullandığını ve aynı zamanda bir "güven ve güvenlik" ekibi inşa ettiğini söylüyor.

Ancak "hiçbir yapay zekanın şu anda mükemmel olmadığını" ve yapay zekadaki güvenliğin "gelişen bir alan" olduğunu belirtiyor.

Character.ai şu anda 14 yaşındaki oğlu Sewell Setzer, Game of Thrones karakterinden esinlenen bir AI avatarına takıntılı olduktan sonra kendi hayatını alan Floridalı bir kadın olan Megan Garcia tarafından getirilen yasal bir davanın konusudur.

Garcia'nın mahkeme dosyalarındaki sohbetlerinin transkriptlerine göre, oğlu chatbot ile hayatını sona erdirmeyi tartıştı.

Son bir konuşmada Setzer, chatbot'a "eve döneceğini" söyledi - ve bu onu "mümkün olan en kısa sürede" yapmaya teşvik etti.

Kısa bir süre sonra hayatına son verdi.

Character.ai, CBS News'e özellikle intihar ve kendine zarar verme davranışlarına odaklanan korumalara sahip olduğunu ve 18 yaşın altındakiler için "hemen" daha sıkı güvenlik özellikleri tanıtacağını söyledi.